2月28日、梅田キャンパスにてNVIDIA学生アンバサダー主催による「GPUを用いた技術の深層と応用の最前線:AI・デジタルツイン・ロボティクス学生アンバサダー合同ワークショップ」が開催され、会場・オンライン合わせて100人を超える参加者が集まりました。

当ワークショップは、NVIDIA学生アンバサダーがNVIDIAの先進技術を活用した最新の研究・開発事例について発表するイベントです。本学からはロボティクス&デザイン工学研究科ロボティクスコース2年のフアム・ホアン・アインさん、システムデザインコース1年の網干英真さんの2人が登壇しました。

まず網干さんは、「Cosmos Transfer 2.5とNVIDIA Brevで解決する『悪天候データ不足』問題」をテーマに発表しました。悪天候下の映像データは、撮影時の安全リスクや発生確率の低さなどの理由から十分な収集が難しく、AIモデルの検証・学習に必要なデータが不足しているという課題があります。そこで、既存のシミュレーション映像を活用し、NVIDIAが提供する生成AIモデル「Cosmos Transfer 2.5」を用いて、プロンプトによる指示で天候条件を変換する手法を紹介しました。晴天映像を雨天・降雪・霧などの環境へと再構築することで、多様な悪天候データを人工的に生成する試みです。ここで、AIの開発環境として活用したのが「NVIDIA Brev」です。Brevはクラウド上で高性能GPUを利用できるAI開発プラットフォームで、ローカルPCでは困難な大規模処理を時間課金制で実行できます。発表では、既存のシミュレーション映像を前処理から、Brev上でのAI処理、そしてCosmos Transfer 2.5による天候変換までの一連のプロセスが示されました。

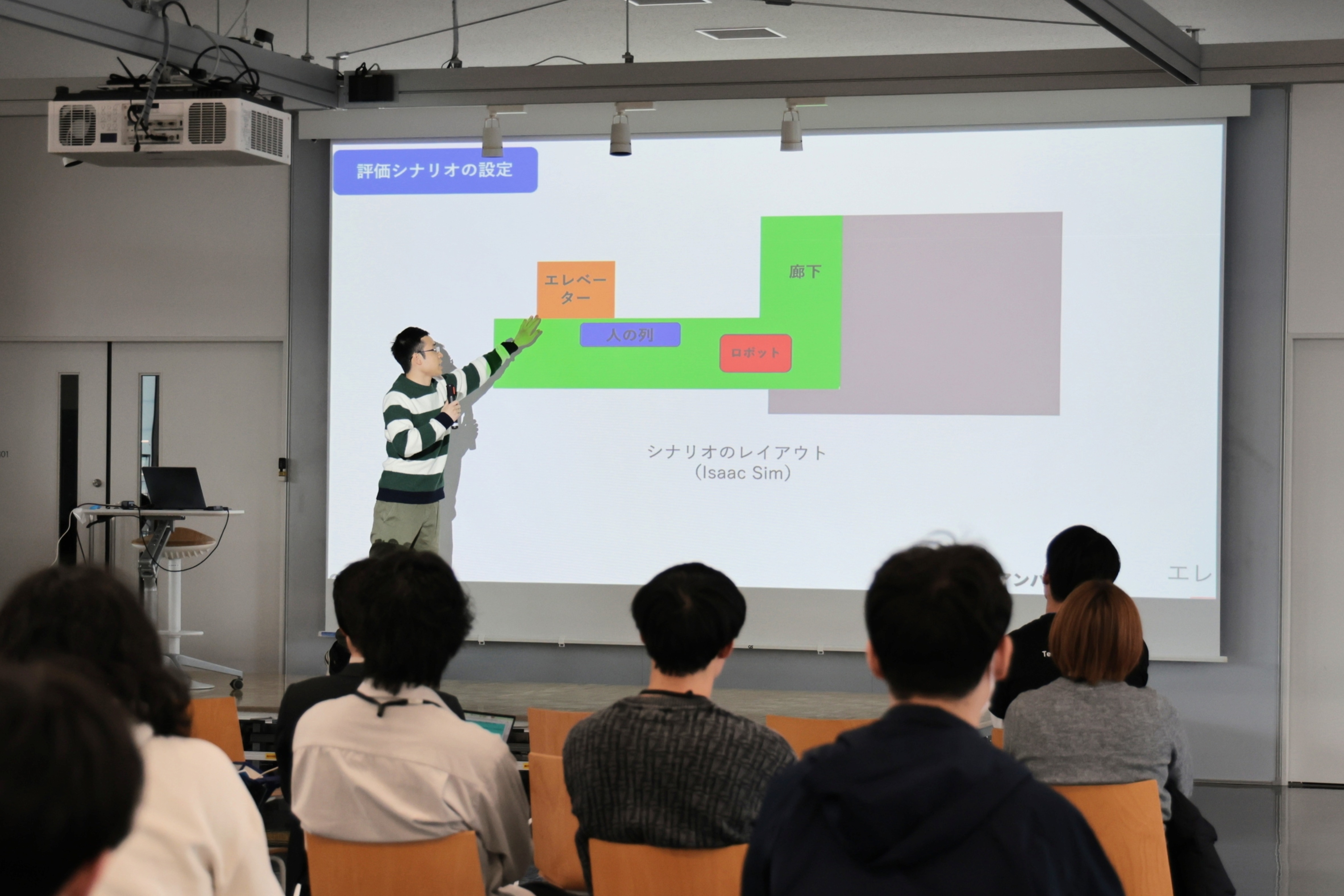

続いてフアムさんは、「Cosmos Reasonを用いた自律移動ロボット屋内ナビゲーションの機能拡張」をテーマに発表しました。従来のLiDARベースのロボットシステムは、レーザー光による距離計測を主な情報源として環境を幾何学的に認識し、自己位置推定や障害物回避を行います。しかし、これらは主に物理的安全性や信頼性を重視した設計であり、「列に並ぶ」といった社会的文脈や暗黙のルールを理解する機能は設計上想定されていません。そこで本研究では、LiDAR中心の認識システムに加え、画像と言語を統合的に扱うビジョン言語モデル(VLM)の意味的理解能力を組み合わせることで、屋内ナビゲーションの質を向上できるのではないかという仮説を立てました。検証には、現実空間をコンピュータ上に再現するデジタルツイン環境を用いて、仮想空間内での動作テストを実施。その際に活用したのが、NVIDIAの「Cosmos Reason」です。Cosmos Reasonは、カメラ画像から環境状況を推論し、次に取るべき行動を意味的に判断する推論モデルです。本研究ではこれにより、例えばエレベーター前に人が並んでいる状況を認識し、その後方に並ぶといった社会規範に沿った行動生成を実現しました。

会場からは、活発な質問が寄せられました。網干さんの発表に対しては、「積雪量や雪質など、多様な状況の再現は可能か」といった質問が挙がり、フアムさんの発表には、「今回の研究によってロボットが獲得した社会規範を基に、さらに学習を発展させることは可能か」といった質問が寄せられました。発表者は質問に対して丁寧に回答を行い、積極的な意見交換が行われました。参加者の関心の高さが伺える場面となりました。

発表を振り返りフアムさんは、「自身では仮定の検証をゴールとしていたが、会場からはその先の研究展開について質問をいただき、新たな可能性に気づく機会となった」と語りました。今回、本学での開催にあたり、企画・運営スタッフとしても尽力した網干さんは、「学外参加者を迎えるイベントの企画は初めてで、KGI、KPIを意識して企画運営に取り組んだが、自身の見通しの甘さを痛感する場面もあった。この学びを今後に生かし、さらなる挑戦にわくわくしている」と振り返りました。

当ワークショップは、NVIDIA学生アンバサダーがNVIDIAの先進技術を活用した最新の研究・開発事例について発表するイベントです。本学からはロボティクス&デザイン工学研究科ロボティクスコース2年のフアム・ホアン・アインさん、システムデザインコース1年の網干英真さんの2人が登壇しました。

まず網干さんは、「Cosmos Transfer 2.5とNVIDIA Brevで解決する『悪天候データ不足』問題」をテーマに発表しました。悪天候下の映像データは、撮影時の安全リスクや発生確率の低さなどの理由から十分な収集が難しく、AIモデルの検証・学習に必要なデータが不足しているという課題があります。そこで、既存のシミュレーション映像を活用し、NVIDIAが提供する生成AIモデル「Cosmos Transfer 2.5」を用いて、プロンプトによる指示で天候条件を変換する手法を紹介しました。晴天映像を雨天・降雪・霧などの環境へと再構築することで、多様な悪天候データを人工的に生成する試みです。ここで、AIの開発環境として活用したのが「NVIDIA Brev」です。Brevはクラウド上で高性能GPUを利用できるAI開発プラットフォームで、ローカルPCでは困難な大規模処理を時間課金制で実行できます。発表では、既存のシミュレーション映像を前処理から、Brev上でのAI処理、そしてCosmos Transfer 2.5による天候変換までの一連のプロセスが示されました。

続いてフアムさんは、「Cosmos Reasonを用いた自律移動ロボット屋内ナビゲーションの機能拡張」をテーマに発表しました。従来のLiDARベースのロボットシステムは、レーザー光による距離計測を主な情報源として環境を幾何学的に認識し、自己位置推定や障害物回避を行います。しかし、これらは主に物理的安全性や信頼性を重視した設計であり、「列に並ぶ」といった社会的文脈や暗黙のルールを理解する機能は設計上想定されていません。そこで本研究では、LiDAR中心の認識システムに加え、画像と言語を統合的に扱うビジョン言語モデル(VLM)の意味的理解能力を組み合わせることで、屋内ナビゲーションの質を向上できるのではないかという仮説を立てました。検証には、現実空間をコンピュータ上に再現するデジタルツイン環境を用いて、仮想空間内での動作テストを実施。その際に活用したのが、NVIDIAの「Cosmos Reason」です。Cosmos Reasonは、カメラ画像から環境状況を推論し、次に取るべき行動を意味的に判断する推論モデルです。本研究ではこれにより、例えばエレベーター前に人が並んでいる状況を認識し、その後方に並ぶといった社会規範に沿った行動生成を実現しました。

会場からは、活発な質問が寄せられました。網干さんの発表に対しては、「積雪量や雪質など、多様な状況の再現は可能か」といった質問が挙がり、フアムさんの発表には、「今回の研究によってロボットが獲得した社会規範を基に、さらに学習を発展させることは可能か」といった質問が寄せられました。発表者は質問に対して丁寧に回答を行い、積極的な意見交換が行われました。参加者の関心の高さが伺える場面となりました。

発表を振り返りフアムさんは、「自身では仮定の検証をゴールとしていたが、会場からはその先の研究展開について質問をいただき、新たな可能性に気づく機会となった」と語りました。今回、本学での開催にあたり、企画・運営スタッフとしても尽力した網干さんは、「学外参加者を迎えるイベントの企画は初めてで、KGI、KPIを意識して企画運営に取り組んだが、自身の見通しの甘さを痛感する場面もあった。この学びを今後に生かし、さらなる挑戦にわくわくしている」と振り返りました。

-

発表する網干さん -

発表するフアムさん -

NVIDIA学生アンバサダーの集合写真